K.G.Denbigh (1975), „An Inventive Universe“, London: Hutchinson & Co.

BISHER

Im Teil 1 der Relektüre von Kenneth George Denbighs Buch „An Inventive Universe“ hatte ich, sehr stark angeregt durch die Lektüre, zunächst eher mein eigenes Verständnis von dem Konzept ‚Zeit‘ zu Papier gebracht und eigentlich kaum die Position Denbighs referiert. Darin habe ich sehr stark darauf abgehoben, dass die Struktur der menschlichen Wahrnehmung und des Gedächtnisses es uns erlaubt, subjektiv Gegenwart als Jetzt zu erleben im Vergleich zum Erinnerbaren als Vergangen. Allerdings kann unsere Erinnerung stark von der auslösenden Realität abweichen. Im Lichte der Relativitätstheorie ist es zudem unmöglich, den Augenblick/ das Jetzt/ die Gegenwart objektiv zu definieren. Das individuelle Jetzt ist unentrinnbar subjektiv. Die Einbeziehung von ‚Uhren-Zeit’/ technischer Zeit kann zwar helfen, verschiedene Menschen relativ zu den Uhren zu koordinieren, das grundsätzliche Problem des nicht-objektiven Jetzt wird damit nicht aufgelöst.

In der Fortsetzung 1b von Teil 1 habe ich dann versucht, die Darlegung der Position von Kenneth George Denbighs Buch „An Inventive Universe“ nachzuholen. Der interessante Punkt hier ist der Widerspruch innerhalb der Physik selbst: einerseits gibt es physikalische Theorien, die zeitinvariant sind, andere wiederum nicht. Denbigh erklärt diese Situation so, dass er die zeitinvarianten Theorien als idealisierende Theorien darstellt, die von realen Randbedingungen – wie sie tatsächlich überall im Universum herrschen – absehen. Dies kann man daran erkennen, dass es für die Anwendung der einschlägigen Differentialgleichungen notwendig sei, hinreichende Randbedingungen zu definieren, damit die Gleichungen gerechnet werden können. Mit diesen Randbedingungen werden Start- und Zielzustand aber asymmetrisch.

Auch würde ich hier einen Nachtrag zu Teil 1 der Relektüre einfügen: in diesem Beitrag wurde schon auf die zentrale Rolle des Gedächtnisses für die Zeitwahrnehmung hingewiesen. Allerdings könnte man noch präzisieren, dass das Gedächtnis die einzelnen Gedächtnisinhalte nicht als streng aufeinanderfolgend speichert, sondern eben als schon geschehen. Es ist dann eine eigene gedankliche Leistungen, anhand von Eigenschaften der Gedächtnisinhalte eine Ordnung zu konstruieren. Uhren, Kalender, Aufzeichnungen können dabei helfen. Hier sind Irrtümer möglich. Für die generelle Frage, ob die Vorgänge in der Natur gerichtet sind oder nicht hilft das Gedächtnis von daher nur sehr bedingt. Ob A das B verursacht hat oder nicht, bleibt eine Interpretationsfrage, die von zusätzlichem Wissen abhängt.

Im Teil 2 ging es um den Anfang von Kap.2 (Dissipative Prozesse) und den Rest von Kap.3 (Formative Prozesse). Im Kontext der dissipativen (irreversiblen) Prozesse macht Denbigh darauf aufmerksam, dass sich von der Antike her in der modernen Physik eine Denkhaltung gehalten hat, die versucht, die reale Welt zu verdinglichen, sie statisch zu sehen (Zeit ist reversibel). Viele empirische Fakten sprechen aber gegen die Konservierung und Verdinglichung (Zeit ist irreversibel). Um den biologischen Phänomenen gerecht zu werden, führt Denbigh dann das Konzept der ‚Organisation‘ und dem ‚Grad der Organisiertheit‘ ein. Mit Hilfe dieses Konzeptes kann man Komplexitätsstufen unterscheiden, denen man unterschiedliche Makroeigenschaften zuschreiben kann. Tut man dies, dann nimmt mit wachsender Komplexität die ‚Individualität‘ zu, d.h. die allgemeinen physikalischen Gesetze gelten immer weniger. Auch gewinnt der Begriff der Entropie im Kontext von Denbighs Überlegungen eine neue Bedeutung. Im Diskussionsteil halte ich fest: Im Kern gilt, dass maximale Entropie vorliegt, wenn keine Energie-Materie-Mengen verfügbar sind, und minimale Entropie entsprechend, wenn maximal viele Energie-Materie-Mengen verfügbar sind. Vor diesem Hintergrund ergibt sich das Bild, dass Veränderungsprozesse im Universum abseits biologischer Systeme von minimaler zu maximaler Entropie zu führen scheinen (dissipative Prozesse, irreversible Prozesse, …), während die biologischen Systeme als Entropie-Konverter wirken! Sie kehren die Prozessrichtung einfach um. Hier stellen sich eine Fülle von Fragen. Berücksichtigt man die Idee des Organiationskonzepts von Denbigh, dann kann man faktisch beobachten, dass entlang einer Zeitachse eine letztlich kontinuierliche Zunahme der Komplexität biologischer Systeme stattfindet, sowohl als individuelle Systeme wie aber auch und gerade im Zusammenspiel einer Population mit einer organisatorisch aufbereiteten Umgebung (Landwirtschaft, Städtebau, Technik allgemein, Kultur, …). Für alle diese – mittlerweile mehr als 3.8 Milliarden andauernde – Prozesse haben wir bislang keine befriedigenden theoretischen Modelle

KAPITEL 4: DETERMINISMUS UND EMERGENZ (117 – 148)

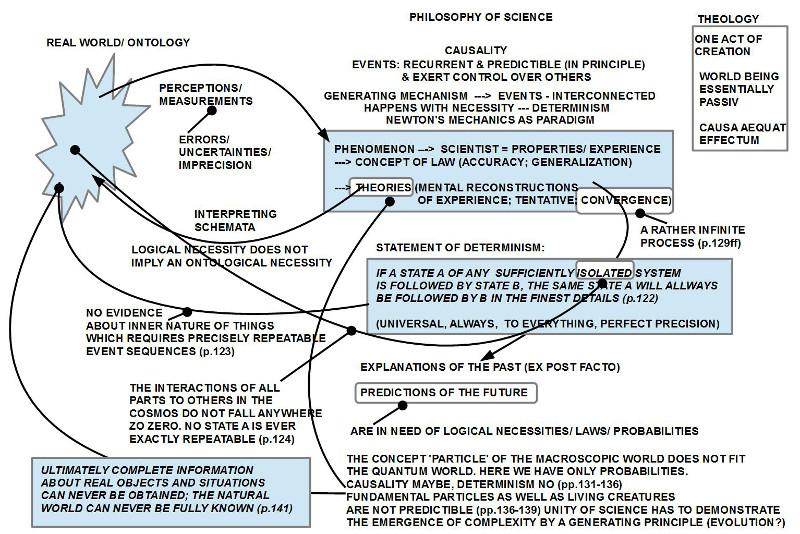

- Dieses Kapitel widmet sich dem Thema Determinismus und Emergenz. Ideengeschichtlich gibt es den Hang wieder, sich wiederholende und darin voraussagbare Ereignisse mit einem Deutungsschema zu versehen, das diesen Wiederholungen feste Ursachen zuordnet und darin eine Notwendigkeit, dass dies alles passiert. Newtons Mechanik wird in diesem Kontext als neuzeitliche Inkarnation dieser Überzeugungen verstanden: mit klaren Gesetzen sind alle Bewegungen berechenbar.

- Dieses klare Bild korrespondiert gut mit der christlichen theologischen Tradition, nach der ein Schöpfer alles in Bewegung gesetzt hat und nun die Welt nach einem vorgegebenen Muster abläuft, was letztlich nur der Schöpfer selbst (Stichwort Wunder) abändern kann.

- Die neuzeitliche Wissenschaft hat aber neben dem Konzept des Gesetzes (‚law‘) auch das Konzept Theorie entwickelt. Gesetze führen innerhalb einer Theorie kein Eigenleben mehr sondern sind Elemente im Rahmen der Theorie. Theorien sind subjektive Konstruktionen von mentalen Modellen, die versuchen, die empirischen Phänomene zu beschreiben. Dies ist ein Näherungsprozess, der – zumindest historisch – keinen eindeutigen Endpunkt kennt, sondern empirisch bislang als eher unendlich erscheint.

- Eine moderne Formulierung des deterministischen Standpunktes wird von Denbigh wie folgt vorgeschlagen: Wenn ein Zustand A eines hinreichend isolierten Systems gefolgt wird von einem Zustand B, dann wird der gleiche Zustand A immer von dem Zustand B gefolgt werden, und zwar bis in die letzten Details.(S.122)

- Diese Formulierung wird begleitend von den Annahmen, dass dies universell gilt, immer, für alles, mit perfekter Präzision.

- Dabei muss man unterscheiden, ob die Erklärung nur auf vergangene Ereignisse angewendet wird (‚ex post facto‘) oder zur Voraussage benutzt wird. Letzteres gilt als die eigentliche Herausforderung.

- Wählt man die deterministische Position als Bezugspunkt, dann lassen sich zahlreiche Punkte aufführen, nach denen klar ist, dass das Determinismus-Prinzip unhaltbar ist. Im Folgenden eine kurze Aufzählung.

- Die Interaktion aller Teile im Universum ist nirgendwo (nach bisherigem Wissen) einfach Null. Zudem ist die Komplexität der Wechselwirkung grundsätzlich so groß, dass eine absolute Isolierung eines Teilsystems samt exakter Reproduktion als nicht möglich erscheint.

- Generell gibt es das Problem der Messfehler, der Messungenauigkeiten und der begrenzten Präzision. Mit der Quantenmechanik wurde klar, dass wir nicht beliebig genau messen können, dass Messen den Gegenstand verändert. Ferner wurde klar, dass Messen einen Energieaufwand bedeutet, der umso größer wird, je genauer man messen will. Ein erschöpfendes – alles umfassende – Messen ist daher niemals möglich.

- Im Bereich der Quanten gelten maximal Wahrscheinlichkeiten, keine Notwendigkeiten. Dies schließt nicht notwendigerweise ‚Ursachen/ Kausalitäten‘ aus.

- Die logischen Konzepte der mentalen Modelle als solche sind nicht die Wirklichkeit selbst. Die ‚innere Natur der Dinge‘ als solche ist nicht bekannt; wir kennen nur unsere Annäherungen über Messereignisse. Das, was ‚logisch notwendig‘ ist, muss aus sich heraus nicht ontologisch gültig sein.

- Neben den Teilchen sind aber auch biologische Systeme nicht voraussagbar. Ihre inneren Freiheitsgrade im Verbund mit ihren Dynamiken lassen keine Voraussage zu.

- Aus der Literatur übernimmt Denbigh die Komplexitätshierarchie (i) Fundamentale Teilchen, (ii) Atome, (iii) Moleküle, (iv) Zellen, (v) Multizelluläre Systeme, (vi) Soziale Gruppen.(vgl. S.143)

- Traditioneller Weise haben sich relativ zu jeder Komplexitätsstufe spezifische wissenschaftliche Disziplinen herausgebildet, die die Frage nach der Einheit der Wissenschaften aufwerfen: die einen sehen in den Eigenschaften höherer Komplexitätsstufen emergente Eigenschaften, die sich nicht auf die einfacheren Subsysteme zurückführen lassen; die Reduktionisten sehen die Wissenschaft vollendet, wenn sich alle komplexeren Eigenschaften auf Eigenschaften der Ebenen mit weniger Komplexität zurückführen lassen. Während diese beiden Positionen widersprüchlich erscheinen, nimmt das Evolutionskonzept eine mittlere Stellung ein: anhand des Modells eines generierenden Mechanismus wird erläutert, wie sich komplexere Eigenschaften aus einfacheren entwickeln können.

DISKUSSION

- Fasst man alle Argument zusammen, ergibt sich das Bild von uns Menschen als kognitive Theorientwickler, die mit ihren kognitiven Bildern versuchen, die Strukturen und Dynamiken einer externen Welt (einschließlich sich selbst) nach zu zeichnen, die per se unzugänglich und unerkennbar ist. Eingeschränkte Wahrnehmungen und eingeschränkte Messungen mit prinzipiellen Messgrenzen bilden die eine Begrenzung, die daraus resultierende prinzipielle Unvollständigkeit aller Informationen eine andere, und schließlich die innere Logik der realen Welt verhindert ein einfaches, umfassendes, eindeutiges Zugreifen.

- Die mangelnde Selbstreflexion der beteiligten Wissenschaftler erlaubt streckenweise die Ausbildung von Thesen und Hypothesen, die aufgrund der möglichen Methoden eigentlich ausgeschlossen sind.

- Die noch immer geltende weitverbreitete Anschauung, dass in der Wissenschaft der Anteil des Subjektes auszuklammern sei, wird durch die vertiefenden Einsichten in die kognitiven Voraussetzungen aller Theorien heute neu in Frage gestellt. Es geht nicht um eine Infragestellung des Empirischen in der Wissenschaft, sondern um ein verstärktes Bewusstheit von den biologischen (beinhaltet auch das Kognitive) Voraussetzungen von empirischen Theorien.

- In dem Maße, wie die biologische Bedingtheit von Theoriebildungen in den Blick tritt kann auch die Besonderheit der biologischen Komplexität wieder neu reflektiert werden. Das Biologische als Entropie-Konverter (siehe vorausgehenden Beitrag) und Individualität-Ermöglicher jenseits der bekannten Naturgesetze lässt Eigenschaften der Natur aufblitzen, die das bekannte stark vereinfachte Bild kritisieren, sprengen, revolutionieren.

- Die Idee eines evolutionären Mechanismus zwischen plattem Reduktionismus und metaphysischem Emergenz-Denken müsste allerdings erheblich weiter entwickelt werden. Bislang bewegt es sich im Bereich der Komplexitätsebenen (iii) Moleküle und (iv) Zellen.

Fortsetzung mit TEIL 4

QUELLEN

- Kenneth George Denbigh (1965 – 2004), Mitglied der Royal Society London seit 1965 (siehe: https://en.wikipedia.org/wiki/List_of_Fellows_of_the_Royal_Society_D,E,F). Er war Professor an verschiedenen Universitäten (Cambridge, Edinbugh, London); sein Hauptgebet war die Thermodynamik. Neben vielen Fachartikeln u.a. Bücher mit den Themen ‚Principles of Chemical Equilibrium, ‚Thermodynamics of th Steady State‘ sowie ‚An Inventive Universe‘.

Einen Überblick über alle Blogeinträge von Autor cagent nach Titeln findet sich HIER.

Bild 1

Bild 1 Bild 2

Bild 2